Moral – In unserer Gesellschaft wird die Frage nach der Bildung unseres Wertesystems meist von Philosophen, Theologen oder Anthropologen behandelt. Einerseits geht es um die Klärung der Herkunft: Ist Moral etwas, dass in der Natur des Menschen liegt oder eine Eigenschaft die sozialisiert, also anerzogen, ist? Andererseits beleuchten Forscher die Entwicklung von Moral – sind „Richtig“ und „Falsch“ Konstanten oder sind diese Begriffe wandelbar?

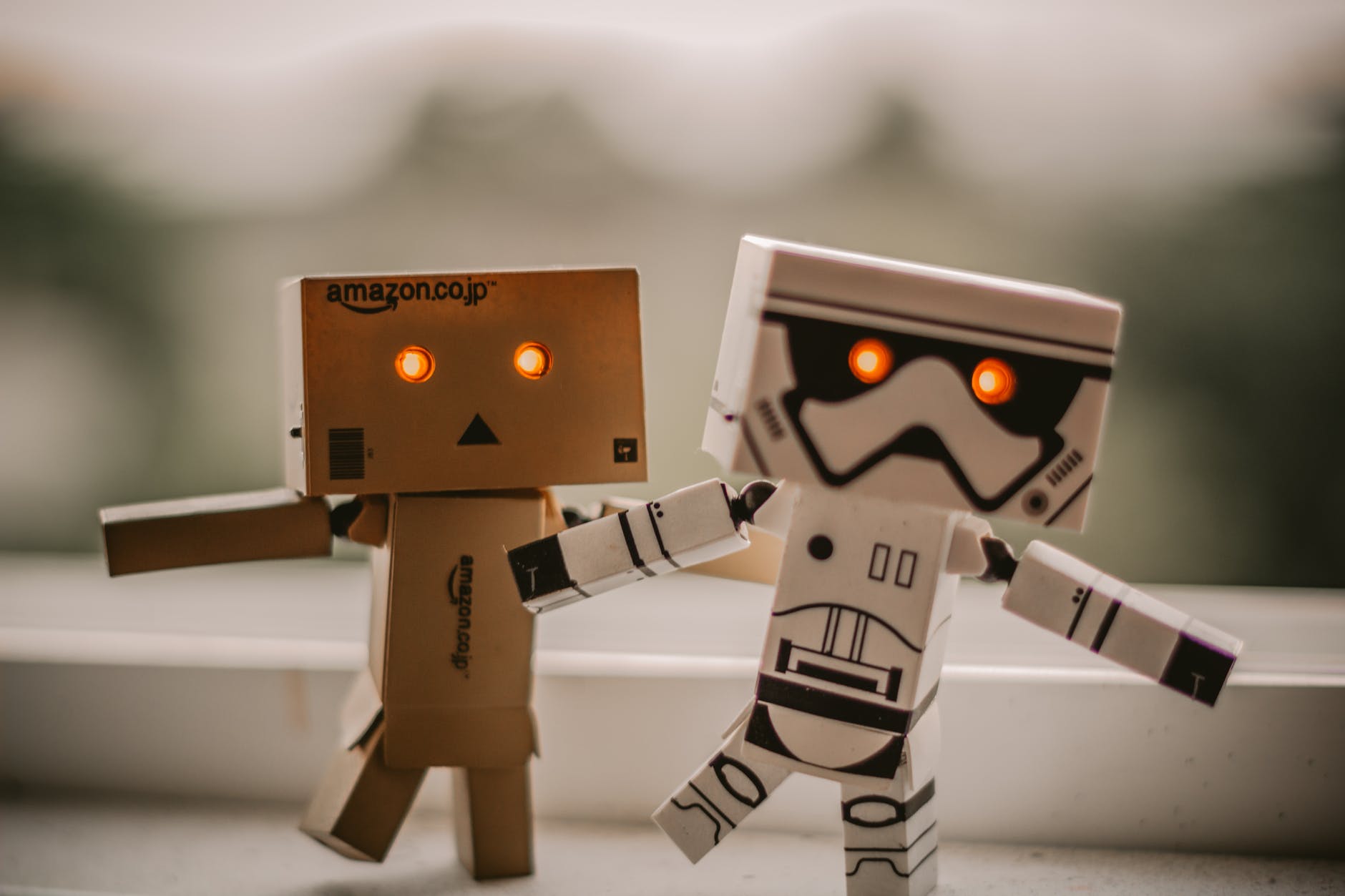

Mit dem Fortschritt von Künstlicher Intelligenz und der immer größeren Verantwortung, die wir in die Hände von Maschinen legen, müssen wir „KI“ auch in das Thema Moral einbeziehen. Wie reagiert beispielsweise ein selbstfahrendes Fahrzeug, wenn es bei einem Ausweichmanöver unweigerlich mit einer Person zusammenstoßen wird und zwischen mehreren Menschen entscheiden muss? Diese klassische Frage ist der Aufhänger des Will Smith Films „iRobot“ (ein Roboter entscheidet sich nach einem Unfall für Smith und lässt ein Kind ertrinken), der trotz des penetranten product placements, die Brisanz der Thematik verdeutlicht.

Kann KI überlegene Moral entwickeln?

Wie so oft überwiegen Negativszenarien bei der Diskussion um den KI-Fortschritt. Künstliche Intelligenz kann uns aber auch bei der Moralentwicklung und bei der Umsetzung unseres moralischen Systems helfen.

Einer der großen Vorteile von Maschinen ist, dass sie Entscheidungen ohne emotionale Einfärbung treffen. Ein KI-Richter oder eine KI-Jury würde demnach ein auf Fakten basiertes Urteil fällen. Diese buchstäblich „unmenschliche“ Objektivität hätte mehrere Vorteile. Nicht nur, weil Faktoren wie Rassismus, Misogynie und ähnliche Weltansichten keinen Einfluss mehr hätten. Ein KI-Richter könnte durch überlegene Rechenkapazität und einer ungetrübten Erfassung der (Rechts-)Lage, Entscheidungen treffen, die gerechter sind.

Urteile sind zu einem gewissen Teil immer auch Ermessenssache. Kein Mensch kann die Bedürfnisse aller Beteiligten eines Prozesses fair einbeziehen. Einer KI wäre dies theoretisch möglich. Diese Fairness könnte in der Folge einen positiven Einfluss auf die Entwicklung unseres Moralsystems haben.

Es gibt einen Haken…

In der Theorie kann KI also durchaus einen Beitrag hin zu einer moralischeren Gesellschaft leisten. KI ist aber auch auf den Input von Daten angewiesen. Da diese unweigerlich von Menschenhand kommen müssen, sind sie entsprechend fehlerhaft.

Die Moralentwicklung von KI muss also permanent überwacht und bei Bedarf korrigiert werden. Folglich werden wir uns nicht darauf verlassen können, dass KI all unsere Probleme löst. Künstliche Intelligenz kann aber eine unschätzbare Unterstützung sein, damit wir Probleme lösen können.

Was meint ihr zu dem Thema Künstliche Intelligenz und Moral? Wird uns KI auch in diesem Bereich weiterbringen?

Der moralische Aspekt eines in sich künstlich generierten Systems, ist so und vor allem in seiner Fülle aktuell schlicht nicht zu beantworten. Unsere Gesellschaft ist nicht auf eine synthetische Ausrichtung bzw durch Maschinen errechnetes Bewusstsein ausgelegt. Wir haben schlicht diesbezüglich noch keine Empathie erlernt. Dass derlei Dinge sehr schnell gehen sehen wir uns an den sozialen Netzwerken. Moralische Handlungen gehen Off und online sehr weit auseinander und verwässern eine Generation später sehr anschaulich. Heißt, da die Technik noch nicht so weit ist, um eine Handlung bzw das lernen zu erzwingen, müssen wir hier fragen und antworten noch immer der Fiktion… Weiterlesen »

Da verlangt der Mensch von der Maschine etwas was er selber nicht kann. Moralisches Handeln mit allen Abwägungen kann der fehlerhafte Mensch ja selber nicht und kritisiert die Maschinen die evtl. ein Kind nicht als primäres Ausweichziel sehen würde. Zum Beispiel bei einer Unfallsituation bei der das Auto entscheiden müsste welches Menschenleben das kleinere moralische Übel wäre. Ist es die Anzahl der Menschen, das Alter, der Status. Wonach wird entschieden. Das ist eine schwierige Frage. Ein Mensch wäre in einer solchen Situation völlig überfordert und würde im Affekt handeln. Also eigentlich gar nicht moralisch. Warum stellt man diese Anforderung aber… Weiterlesen »

KI ist ein technologisches Hilfsmittel/Werkzeug…keine moralische Instanz.

Zumal moralische Werte auch vom Kulturkreis abhängig sind.

Also:

Nein…KI wird keinen Menschen irgendwie moralischer machen.

eh net

Damit eine KI ordentlich funktionieren kann, braucht sie Daten, Daten, Daten und nochmals Daten. Und im Zweifelsfall noch solche Daten wie: Fege ich regelmäßig den Bürgersteig? Bin ich pünktlich genug? Kümmere ich mich gut oder sehr gut um meine Eltern, Kinder, Nachbarn, Haustiere? Wie sieht mein Vorgarten aus? (Und nebenbei: Wer entscheidet, was „gepflegt“ bedeutet?) Das testet gerade China aus. Das Credo dort geht aber letztlich in eine andere Richtung: maximale Kontrolle über die Bürger, Wohlverhalten wird belohnt, individuelle oder abweichende Tendenzen werden bestraft. Die eigentliche Frage lautet dann eben: Wie solll eine KI entscheiden, wenn sie keine Daten oder… Weiterlesen »