Vor kurzem hat Microsoft beschlossen, einen Teil der Redakteure von MSN.com durch eine künstliche Intelligenz zu ersetzten. Diese soll im Internet nach Artikeln von Zeitungen und Co. suchen und diese aufbereiten und auf MSN online stellen. Genau diese KI hat sich jetzt jedoch einen groben Fehler erlaubt und auch der Umgang seitens Microsoft wirft kein gutes Licht auf die Sache.

Siehe auch: [Exklusiv] Kommt eine Surface Watch mit Blutdruckmessung und mehr?

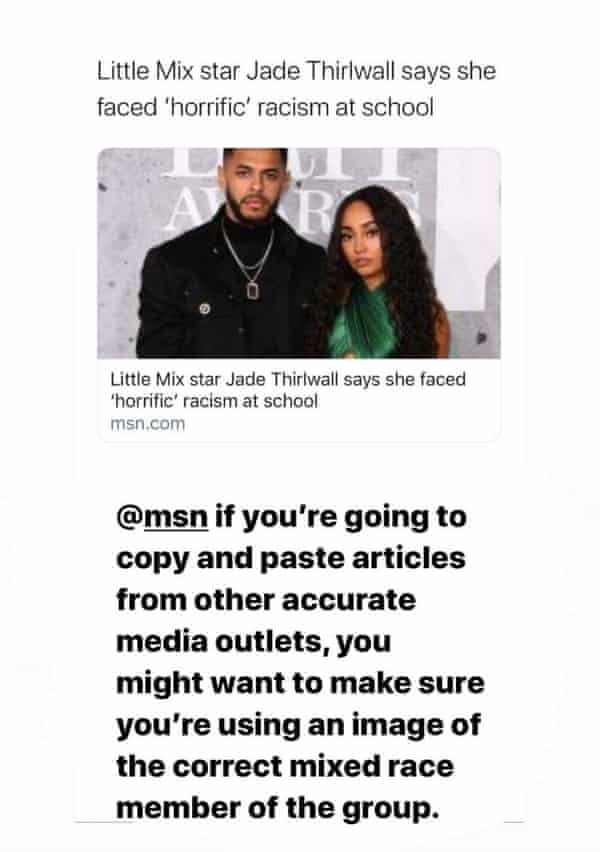

Microsofts MSN KI verwechselt Bandmitglieder

Was war passiert? Jade Thirwall von der Band Little Mix gab ein sehr persönliches Interview über ihre eigenen Erfahrungen mit Rassismus. Der Artikel wurde nun von der künstlichen Intelligenz bei MSN entdeckt und mit einem Foto versehen. Dumm nur, dass es sich hierbei nicht um Jade Thirwall handelte, sondern ihrer Band-Kollegin Leigh-Anne Pinnock.

Microsoft äußerte sich bereits und gab an, dass entsprechende Bild sofort ausgetauscht zu haben. Besonders pikant ist allerdings die Tatsache, dass das Personal von MSN angewiesen wurde, kritische Berichte über den Fall zu löschen. Dies wurde ironischerweise erschwert, da die neue KI diese Artikel durchaus als interessant einstufen konnte. Die menschlichen Mitarbeiter mussten daher stehts darauf achten, diese Artikel abzufangen und die KI an der Veröffentlichung auf MSN zu hindern.

Laut Aussagen eines Mitarbeiters hat Microsoft Sorge, die ganze Sache könnte die Reputation der eigenen KI Systeme beschädigen. Ob eine großangelegte Löschaktion kritischer Artikel dabei jedoch wirklich hilfreich ist, darf bezweifelt werden. Ein offener Umgang mit dem Fehler wäre vermutlich die bessere Wahl gewesen.

Wie seht ihr das? Sollte Microsoft lieber wieder auf menschliche Redakteure setzen oder gehören solche Fehler einfach dazu?

via The Guardian

Das eine KI ein Bild falsch zuordnet kann passieren. Ist halt an dieser Stelle besonders blöd. Dass die KI jedoch im allgemeinen diese Artikel versucht zu zeigen liegt einfach daran, dass sie durchaus recht hat. Die KI soll interessante Artikel zeigen und genau das macht sie (das Thema ist halt aktuell sehr prominent). Die entsprechende Reaktion von Ms hätte jetzt jedoch sein müssen, dass eine zweite KI zum Einsatz kommt, welcher man einfach sagen kann welche Themen aktuell nicht gezeigt werden sollen. Diese kann die entsprechenden Artikel dann aussortieren. Zu der Frage: Nein ich finde nicht, dass hier mehr auf… Weiterlesen »

Mal abgesehen davon, dass ein Redakteur nur auf die Quellen zurückgreift auf die er zurückgreifen will oder soll, also keine absolute Neutralität bei der Auswahl besitzt, und Quellen müssen bei einer Veröffentlichung angegeben werden, dann handelt er, unterm Strich, nicht besser als eine programmierte KI. Wenn die KI bei einem Redakteur dazulernen soll, dann lernt sie dass, was der Redakteur macht, bzw. was vom Unternehmen gewünscht ist. Die Bild auszuschließen mag ja in gewisser Weise nachvollziehbar sein, aber Wissenschaftsmagazine gibt es eben auch aus demselben Verlag. Man kann der KI natürlich eine Unmenge Einschränkungen für die Auswahl der Quellen geben,… Weiterlesen »