Sprachbarrieren gibt es gefühlt seit es Menschen gibt. Mit immer besser werdenden Übersetzer(-Apps) sind diese aber in den vergangenen Jahren merklich kleiner geworden. Mit der italienischen Grossmutter sprechen, ohne Italienisch sprechen zu können? Kein Problem. Doch dank KI geht das Thema nun noch eine markante Stufe weiter. Wie wäre es, wenn du ein Video in deutscher Sprache aufnimmst und die KI generiert daraus dann das gleiche Video auf Französisch oder Italienisch? Und das Ganze inklusive Lippenbewegungen und mit deiner eigenen Stimme? Kein Problem.

ChatGPT, Bard und wie sie alles heissen sind erst der Anfang. Die KI steckt, so bemerkenswert die Fortschritte auch sind, erst in den Kinderschuhen. Passen Microsoft, OpenAI und Google nicht auf, geraten sie sogar relativ schnell ins Hintertreffen. Denn im Bereich der künstlichen Intelligenz gibt es fast täglich News und ab und zu auch mal wieder was, das, zumindest mich, aus den Socken haut. Eines dieser Beispiele stammt von HeyGen.

Video aufnehmen, Sprache wählen, fertig.

Es ist so einfach, wie genial. Du nimmst ein Video von dir selbst auf (mind. 30 Sekunden) und lädst es bei HeyGen hoch. Danach wählst du die gewünschte Sprache (es werden derzeit noch nicht sehr viele unterstützt) und lässt das Video neu rendern. Als Ergebnis kommt dein Video in einer anderen Sprache heraus – mit deiner Stimme und einer anderen Sprache.

Jon Finger hat dies mit dem HeyGen Translator in der Gratis-Probeversion ausprobiert und erklärt in seinem Video auf Englisch, dass er mindestens 30 Sekunden sprechen müsse, damit das Tool die Übersetzung durchführen könne.

User sind beeindruckt

Die Meinungen über die Qualität der Übersetzung sind in den Kommentaren geteilt. Dennoch scheint das Video für Gesprächsstoff auf Social Media zu sorgen. Innerhalb eines Tages wurde der zum Video gehörige Tweet bereits über 2200 Mal geteilt. In den Kommentaren wird das Video als „unglaublich“ beschrieben, wenngleich der Ton angeblich noch roborterhaft rüberkommt und etwas zu generisch klingt. Dennoch sind sich die meisten Leute beeindruckt von dieser neuen Art der Kommunikation. Man stelle sich vor, der CEO einer Firma erstellt ein Video auf Deutsch und dieses wird im Anschluss einfach in die anderen Sprachen übersetzt – und dabei sieht es auch noch so aus, als ob der CEO plötzlich multilingual unterwegs ist. Das dürfte in Zukunft damit möglich sein und ich gehe davon aus, dass es nur eine Frage der Zeit ist, bis es auch Apps fürs Smartphone geben wird, die genau das können.

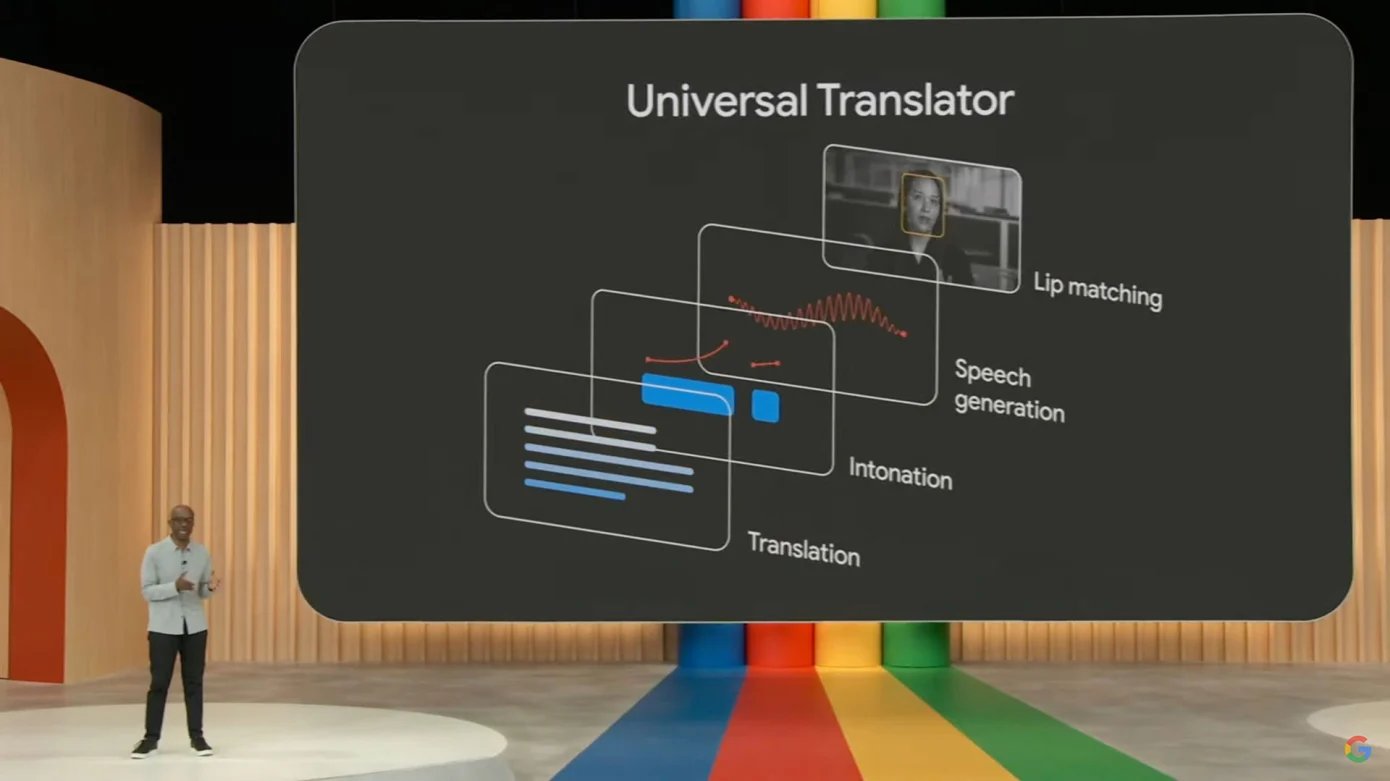

Auch Google arbeitet bereits an „Universal Translator“

Bereits im Mai 2023 hat Google seinen „Universal Translator“ vorgestellt, der die Stimme eines Sprechers / einer Sprecherin nicht nur übersetzt, sondern auch die Lippenbewegungen dabei synchronisiert. Die Technologie dazu existiert bereits und wird wohl auch grosse Gefahren mitbringen. Denn so genannte Deepfakes werden auf diese Art nicht nur populärer, sondern können auch dafür sorgen, dass beispielsweise Politikern fremde Worte in den Mund gelegt werden. Es stellt sich auch nicht die Frage ob das passieren wird, sondern eher wann und wie man dem entgegnen will.

Deepfake und Fake-Bilder fluten Social Media

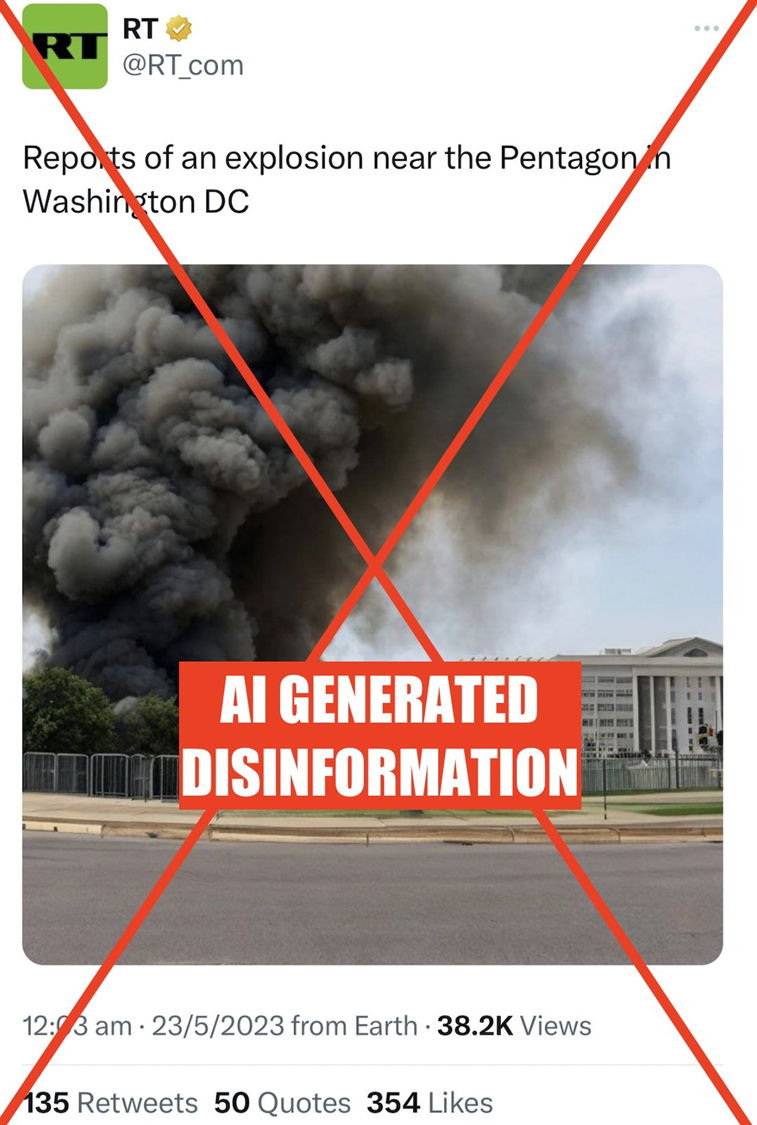

Ein anderes (Negativ-)Beispiel sind die Börsen. So reagierten beispielsweise am 22. Mai 2023 gewisse Aktien (z.B. S&P 500) zeitweise so, als würde Angst den Markt beherrschen. So sanken die Kurse temporär, erholten sich danach aber relativ rasch. Auf der Suche nach Gründen für diese Schwanker tauchte ein Twitter-Account auf, der sehr stark an einen lokalen US-Sender erinnert. Und dieser Account postete ein Bild, das eine angebliche Explosion am Pentagon bei Washington zeigte. Der Tweet wurde von zahlreichen Accounts verbreitet, darunter viele aus der Krypto-Szene und auch der russische Kreml-Propagandasender RT teilte das Bild. Später wurde das Bild wieder von RT gelöscht mit der Info, dass sowas eben bei einer „schnellen Verifikation von Nachrichten“ passieren könne – denn es war schlicht und einfach ein Fake, der heute noch einfacher erstellt werden kann, als es vor einem Jahr bereits der Fall war.

Das Ziel hatte der ursprüngliche Verfasser des Tweets aber erreicht: die Kurse sind, wenn auch nur temporär, gesunken. Ideal um zuzuschlagen und Kursgewinne zu verzeichnen. Und das mit einer simplen KI-gesteuerten Bildbearbeitung, wie sie heute in Sekunden möglich ist.